出品 | 搜狐汽车·汽车咖啡馆

作者 | 杨璐

“基于触控的交互方式不一定适合车”。

5月中旬,理想汽车在硅谷召开一次分享会,智能空间副总裁勾晓菲谈到对智能座舱的思考。他认为,座舱服务的核心点是它的交互形式。

现在的智能座舱的交互主要是触控为主,语音为辅。按照理想汽车勾晓菲的说法,智能座舱的更好的交互方式会是语音为主,触控为辅。

这种需求变化主因是触摸控制的受限性。触控基于前排屏幕,而驾驶员又只能触到中控位置,同时占用手、眼会导致驾驶分心,但当前的语音控制水平还不足以承担起“第一交互通道”的重任。

在业内人士以及消费者看来,当前所谓的“智能座舱”大多带了几分敷衍,比如语音交互不流畅、查找功能不便捷,“智能化”反而成了“低智商”。

让智能座舱从“能用”到“好用”,提升交互能力是根本。今年,在一些公司的新品发布中,屡次提到交互系统提升,百度Apollo明确提出,文心大模型将让智舱在语音交互方面响应更快、驾乘感受更好。

座舱的“堆料”瓶颈有待突破

如今,只要坐上一辆新能源汽车,超大中控屏幕、智能语音对话等功能已经不足为奇,只不过按照车型级别和配置高低,这些功能的体验感有好有差。

为了追求座舱差异化,主机厂只好拼功能数量,诸如屏幕跟随音乐旋转跳动、巨幕观影、座舱音乐厅等等,叠加看似酷炫、实则在驾乘中并不触及智能核心的功能。

智能驾驶解决方案研发商MINIEYE的智能座舱负责人杨一泓表示,现在的智能座舱带来一个问题是:消费者学习成本变高。

“智能手机对很多老年人是不太友好的,汽车也如此。如果某些智能化功能太过复杂,那么驾乘人员可能使用频率就会降低,反而荒废了这些功能。所以智能座舱的交互设计,我认为不能“炫技”,而是从实际功能性出发,真的让消费者用起来,并且喜欢用。”杨一泓说道。

车企也认识到这类问题,梧桐车联(长安汽车与腾讯合资公司)战略管理高级总监崔睿哲认为,智能座舱某种程度上正经历“堆配置、堆功能”的阶段,公司在做一些“减法”。

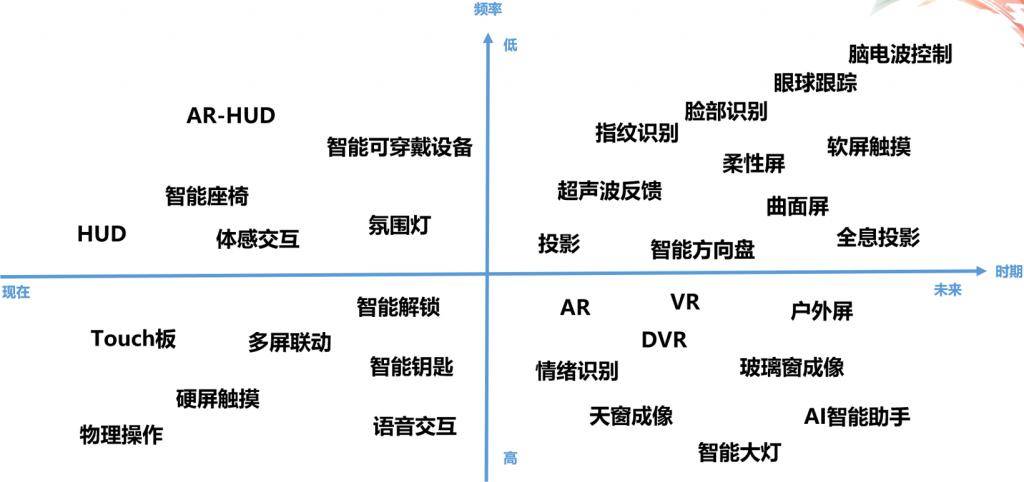

6月份,中科创达智能汽车副总裁陈啸在2023江淮汽车智能网联与线控底盘论坛上,发表了对智能座舱进程趋势的观点:从用户使用功能的频率和所采用的技术成熟度上看,划分为四个象限,第四象限中的使用频率更高、技术更成熟的应用是智能座舱真正需要的功能。

图源:中科创达

图源:中科创达

第四象限中场景功能包括AR/VR、玻璃窗/天窗成像、情绪识别等。与现在的多屏联动、硬屏触摸相做对比,主要是交互方式的变化,从物理触摸变成虚拟控制,即通过语音、眼睛、手势等。

所以当Apple Vision Pro问世,MR(混合现实)上车再被热议。事实上,小部分车企已经做了相关尝试,像蔚来的AR眼镜,奥迪的车载VR体验系统……只不过离完美的交互状态还差很远。

智能座舱交互需要一场蜕变。

抢夺多模交互市场 拐点何时到来?

“实体屏幕依然会存在,但我有一个判断,未来实体屏幕和触控将不再是座舱交互的中心,取而代之的是自然交互(语音、手势、眼球跟踪)+AR-HUD”,地平线生态发展与战略规划副总裁李星宇在去年就提出过此观点。

触摸控制需要占用驾驶员手和眼的使用资源,会对使用驾驶模式的人产生驾驶的安全隐患。所以,未来的交互模式必然是多“感官”融合。今年来看,感官融合领域进展情况如何呢?

语音交互:如前文所言,语音交互能力提升将对座舱交互生态发展起核心作用。当前,已经有量产车型可以实现语音连续对话、免唤醒词等功能,不过在语音识别和语义理解方面还有很大的提升空间。

在多模态融合趋势下,强化语音也离不开视觉、手势的参与。科大讯飞提出在语音识别方面,通过深度降噪技术使其在高噪场景下识别率超92%;并且车内注视感知采用视线交互技术及DMS,该技术于去年底在星途瑶光车型上落地量产;行为感知支持10多种手势交互。

多模多通道语音分离技术让汽车听得更清楚,比如唇形+声音融合,让系统的感知更准确。

手势交互:汽车上的手势交互效仿手机,“对着镜头比个耶,自动拍张照片……”,起初,一些“无用”的功能搬上汽车,现在手势交互得到了更广的融合应用。目前在理想等品牌车型上,语音与手势交互已在多处使用。比如用手指向窗户、同时说“把它打开”,系统便能会意执行。

手势在交互中的地位如同人际交流中的肢体语言,在人机交互更深层面少不了手势的加入。Apple Vision Pro已经阐明了这一点,它就是靠追踪人的眼神和手势来完成任务操作。

视觉交互:眼神交流在今后的座舱内会成为一大流行趋势。当前眼球跟踪系统已经应用于安全检测方面,包括DMS(驾驶员监控系统)和OMS(车内人员监控系统)。

此外,AR-HUD也为视觉增加安全性,以防驾驶员看屏幕而将视线离开路面,但AR-HUD的显示信息又不能遮挡实际道路信息,所以就如何平衡人眼观感提出更多考验。

人体感官与机器的自然交互是实现智能座舱的终极形态,其中“多模态融合”已是不可逾越的环节。

进展至此,多模态融合最大的挑战有哪些?搜狐汽车对业内专家进行了询问,经综合整理,其挑战集中在几个方面:

第一,算力要求更高。不仅是CPU算力,GPU和NPU都要求更高的算力,所以需要对座舱SoC有足够深的了解才能很好的运用这些算力。不过,随着多模态融合的产品价值被车企关注到,将会分配更多算力用于多模态融合落地,且座舱SOC的算力也在不断提升。

第二,硬件设备需求大。智能座舱将为满足舱内全员的不同需求,需要更多摄像头、麦克风、屏幕、音响等,如何协调这些设备将成为智能座舱的挑战。

但当前摄像头配比率仍是偏低的,无法做到所有车型的一致性体验,只能在部分高配车型上部署,制约了多模态融合的发展。随着C-NCAP法规的推进,预计2025年会实施DMS上车标准,届时DMS配比会大幅提升,助力多模态融合发展。

第三,集成复杂度提升。不管是单从智能座舱来说,还是舱驾融合,信息交互的复杂度大大提高。例如在人机共驾阶段,如何通过高效的HMI(人机界面)让用户在自主驾驶和自动驾驶间安全切换?

在产业链企业看来,技术演进要有更多的上车训练。MINIEYE表示,情绪识别等技术领域,其实对于研发商来说已经有了一定积累,但如何把技术转化为功能和产品,并且让消费者买单,更多是主机厂的考量。

科大讯飞也认为,随着应用越来越广泛,主机厂和供应商共同协作,多模态交互才会逐步成熟。

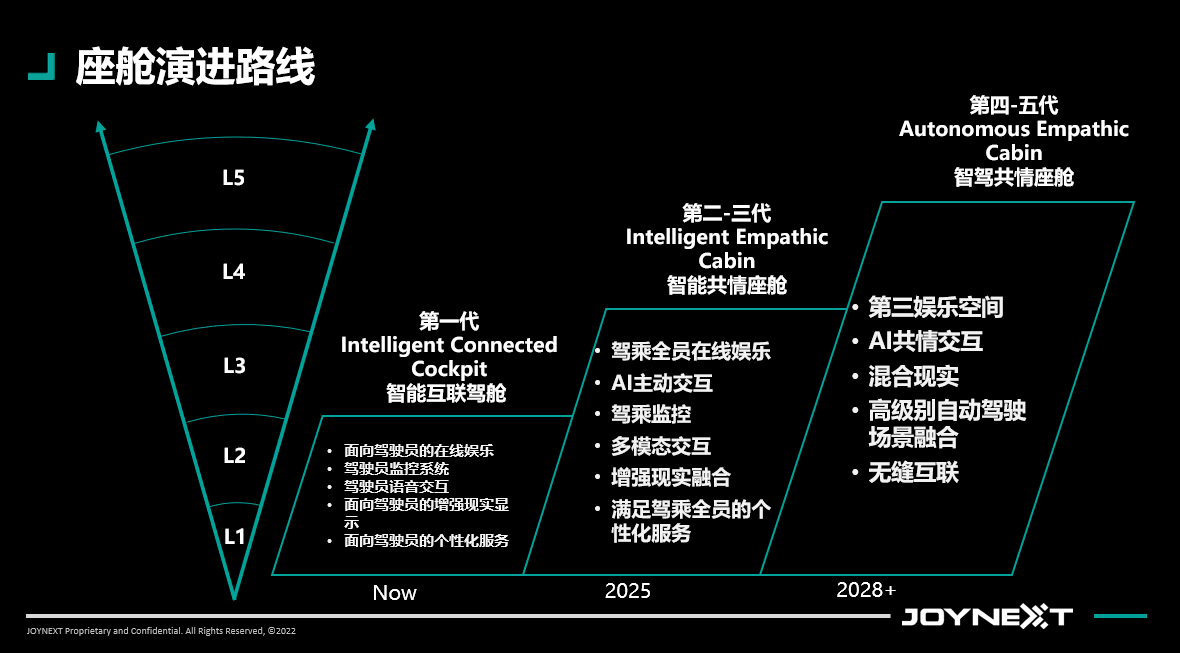

均联智行中国区 CTO朱魁 表示,2015年至今,座舱进入第一个智能阶段——「智能互联驾舱」;现阶段到 2025 年左右为「智能共情座舱」阶段,将实现多模态交互和 AI 主动交互,可以满足驾乘全员的在线娱乐和个性化服务。

图源:均联智行

图源:均联智行

小结

自2015年互联网进入汽车,智能座舱的演进维度愈加广阔。仅交互系统就涉及语音、视觉、手势等,此外还有芯片、域控制器、传感器等硬件设备。

华安证券报告称,智能座舱将拥有千亿细分市场。在座舱光学领域,预计2025 年全球舱内摄像头核心部件CIS 芯片市场规模达2.2 亿美元,预计2025 年全球乘用车HUD 市场空间达47.3 亿美元;座舱声学领域,预计2025 年全球车载功放市场规模达46.6 亿美元。

当自动驾驶风潮渐弱、落地艰难的时刻,智能座舱产业再次升温,智能座舱领域细分赛道的宝藏有待挖掘。

在线客服1

在线客服1